| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | |||

| 5 | 6 | 7 | 8 | 9 | 10 | 11 |

| 12 | 13 | 14 | 15 | 16 | 17 | 18 |

| 19 | 20 | 21 | 22 | 23 | 24 | 25 |

| 26 | 27 | 28 | 29 | 30 | 31 |

- AI

- pandas

- Deeplearning

- Hadoop

- ggplot

- NLP

- 그래프시각화

- 머신러닝

- 데이터

- HIVE

- 데이터분석

- Python

- 자연어처리

- R그래프

- 그래프

- r

- word2vec

- lstm

- SQL

- 하둡

- R시각화

- 기계학습

- 데이터시각화

- CNN

- 딥러닝

- 빅데이터

- R프로그래밍

- 빅데이터처리

- 주가예측

- 데이터처리

- Today

- Total

목록기계학습 (15)

욱이의 냉철한 공부

[딥러닝 기본] Logistic Regression as a Neural Network

[딥러닝 기본] Logistic Regression as a Neural Network

* 출저 본 개념정리는 제 담당교수님이신 연세대학교 정보대학원 김하영 교수님 수업과 Andrew Ng 교수님의 Coursera 수업을 통해 얻은 정보를 통해 정리했습니다. 자료는 Andrew Ng 교수님의 Coursera 수업자료입니다. * 목차 1. Logistic Regression as a Neural Network 2. Logistic Regression 가중치 초기화 3. Logistic Regression 경사하강법 1. Logistic Regression - Logistic Regression 개요 선형 회귀에서 금액과 채무불이행을 직선의 방정식으로 표현한다는 가설 하에, 주어진 데이터로부터 가중치 W(weight)와 편향 b(bias)를 찾아 데이터를 가장 잘 표현하는 직선을 찾았다. 그런..

[CNN 개념정리] CNN의 발전, 모델 요약정리 1 (AlexNet ~ GoogLeNet)

[CNN 개념정리] CNN의 발전, 모델 요약정리 1 (AlexNet ~ GoogLeNet)

* 참고자료 및 강의 - cs231n 우리말 해석 강의 https://www.youtube.com/watch?v=y1dBz6QPxBc&list=PL1Kb3QTCLIVtyOuMgyVgT-OeW0PYXl3j5&index=6 - Coursera, Andrew Ng교수님 인터넷 강의 * 목차 1. 모델 발전 개요 2. 모델1 : LeNet-5 3. 모델2: AlexNet 4. 모델3 : ZFNet 5. 모델4 : VGG 6. 모델5 : GoogLeNet 7. 모델6 : ResNet 8. 모델7 : DenseNet 1. 모델 발전 개요 - 모델 목표 더 깊은 네트워크를 만들면서, 성능을 높여간다. - 모델 목표를 위해 중요한 것. HOW? 어떻게 학습능력을 높여서 더 깊은 네트워크를 학습했는가? -..

[딥러닝 기본] Deep Learning 기본개념

[딥러닝 기본] Deep Learning 기본개념

* 출저 본 개념정리는 제 담당교수님이신 연세대학교 정보대학원 김하영 교수님 수업과 Andrew 교수님의 Coursera 수업을 통해 얻은 정보를 통해 정리했습니다. 자료는 Andrew 교수님의 Coursera 수업자료입니다. * 목차 1. 인공지능, 기계학습(머신러닝), 딥러닝 2. 기계학습(머신러닝)의 종류 3. 기계학습(머신러닝)의 개요 4. 딥러닝의 개요 3. 딥러닝의 hidden layer의 효과 1. 인공지능, 머신러닝, 딥러닝 - 인공지능 (Artificial Intelligence) 1) 사람처럼 의사결정할 수 있는 지능이 있는 것 2) 기계에 지능이 있는 것처럼 만들어 주는 것 - 기계학습 (Machine Learning) 1) 일종의 소프트웨어 개발자 및 전문가가 일일이 정하지 않고..

[NLP 개념정리] Word Representation : 카운트 기반 단어표현

[NLP 개념정리] Word Representation : 카운트 기반 단어표현

* Word Representation 분류체계 1. Discrete Representation : Local Representation 1) One - hot Vector - One - hot Vector 2) Count Based - Bag of Words (BoW) - Document-Term Matrix (DTM) - (TDM) - Term Frequency-Inverse Document Frequency (TF - IDF) - N-gram Language Model (N-gram) 2. Continuous Representation 1) Prediction Based (Distributed Representation) - Neural Network Language Model (NNLM) or..

[NLP 개념정리] Word Embedding : GloVe

[NLP 개념정리] Word Embedding : GloVe

* 자료출저 및 참고논문 - 논문 GloVe : 2014, Global Vectors for Word Representation * Word Representation 분류체계 1. Discrete Representation : Local Representation 1) One - hot Vector - One - hot Vector 2) Count Based - Bag of Words (BoW) - Document-Term Matrix (DTM) - (TDM) - Term Frequency-Inverse Document Frequency (TF - IDF) - N-gram Language Model (N-gram) 2. Continuous Representation 1) Prediction Base..

[NLP 개념정리] Word Embedding : Word2Vec

[NLP 개념정리] Word Embedding : Word2Vec

* 자료출저 및 참고논문 - 강의 Coursera, Andrew Ng 교수님 인터넷 강의 - 논문 Word2Vec: 2013, Effcient Estimation of Word Representations in Vector Space * Word Representation 관점 : Word Embedding 만들기 1. Discrete Representation : Local Representation 1) One - hot Vector - One - hot Vector 2) Count Based - Bag of Words (BoW) - Document-Term Matrix (DTM) - (TDM) - Term Frequency-Inverse Document Frequency (TF - IDF) - N-..

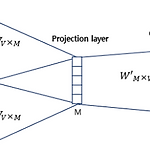

[NLP 개념정리] Word Embedding : NNLM

[NLP 개념정리] Word Embedding : NNLM

* 자료출저 및 참고논문 - 강의 Coursera, Andrew Ng 교수님 인터넷 강의 - 논문 NPLM : A Neural Probabilistic Language Model * Word Representation 분류체계 1. Discrete Representation : Local Representation 1) One - hot Vector - One - hot Vector 2) Count Based - Bag of Words (BoW) - Document-Term Matrix (DTM) - (TDM) - Term Frequency-Inverse Document Frequency (TF - IDF) - N-gram Language Model (N-gram) 2. Continuous Repre..